- חוקה ויסודות המשטר

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

"תיקון חוק יסוד השפיטה – הרכב הוועדה לבחירת שופטים": מורה נבוכים

עמנואל הירשפלד טרכטינגוט

|20.04.2025

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

- ממשל ושירות ציבורי

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

הצעת חוק הרשויות המקומיות (זכויות וחובות של חברי מועצה), התשפ"ג-2023

עו"ד ד"ר מורן נגיד

|01.06.2025

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

- החברה הישראלית

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

- הכנסת, הממשלה

- ממשל ושירות ציבורי

עמנואל הירשפלד טרכטינגוט

|14.05.2026

- זרקור

- נושאים אחרים

- חוקה ויסודות המשטר

- בתקשורת

- השירות הציבורי

- ממשל ושירות ציבורי

- חוות דעת

- "אחד העם"

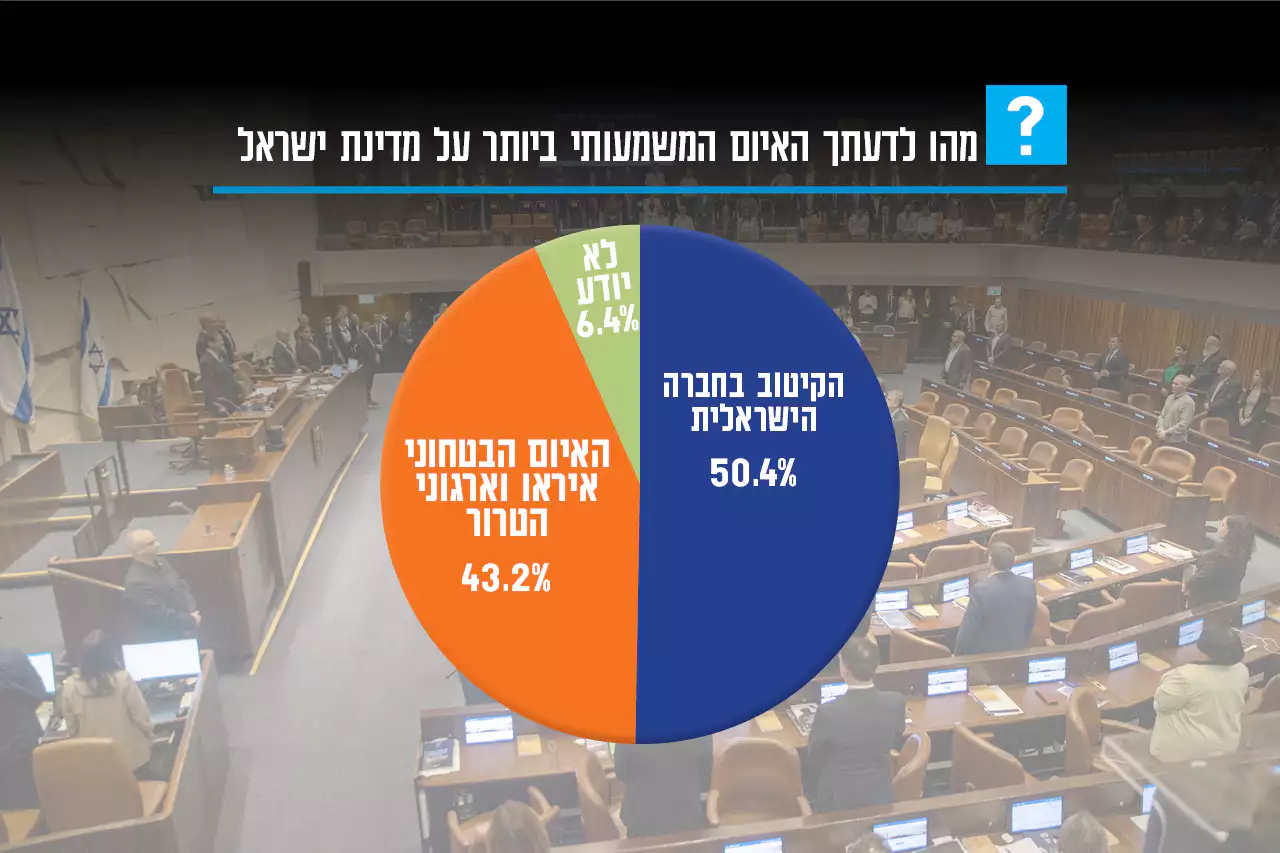

- מחקרי דעת קהל